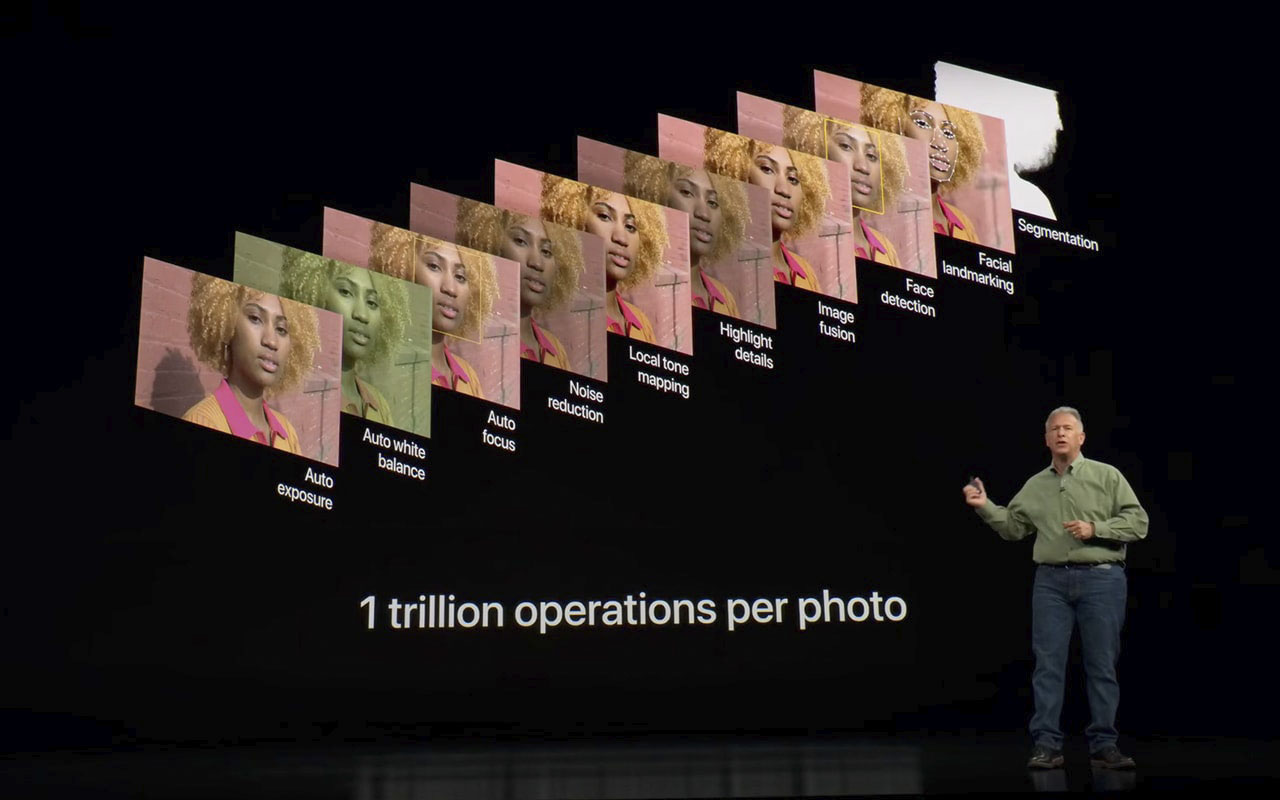

La qualità fotografica degli smartphone ha raggiunto livelli impensabili fino a qualche anno fa grazie alla fotografia computazionale. Questa permette di superare i pesanti limiti strutturali degli smartphone, ossia sensori con elevato rumore e obiettivi poco luminosi. Flussi di dati sempre più ingenti e algoritmi sempre più sofisticati resi possibili da processori sempre più performanti permettono agli smartphone di produrre scatti molto convincenti anche in condizioni di illuminazione proibitive.

Tutto questo ci sta portando verso una nuova concezione di fotografia. O meglio ci ha già portati e forse non ce ne siamo ancora accorti.

L’Intelligenza Artificiale nella fotografia computazionale

Ora che alla fotografia computazionale si inizia ad aggiungere l’intelligenza artificiale forse è arrivato il momento di comprendere meglio cosa sta accadendo nel mondo della fotografia. Sì, certo, stiamo parlando di smartphone. Ma è qui che spesso si vedono soluzioni pionieristiche che prima o poi vengono travasate nelle vere macchine fotografiche.

Per provare a comprendere la trama dobbiamo porci una semplice domanda: per avere fotografie tecnicamente ineccepibili, a cosa siamo disposti a rinunciare? E in particolare, siamo disposti a rinunciare al nostro potere decisionale?

Facciamo un semplice esempio.

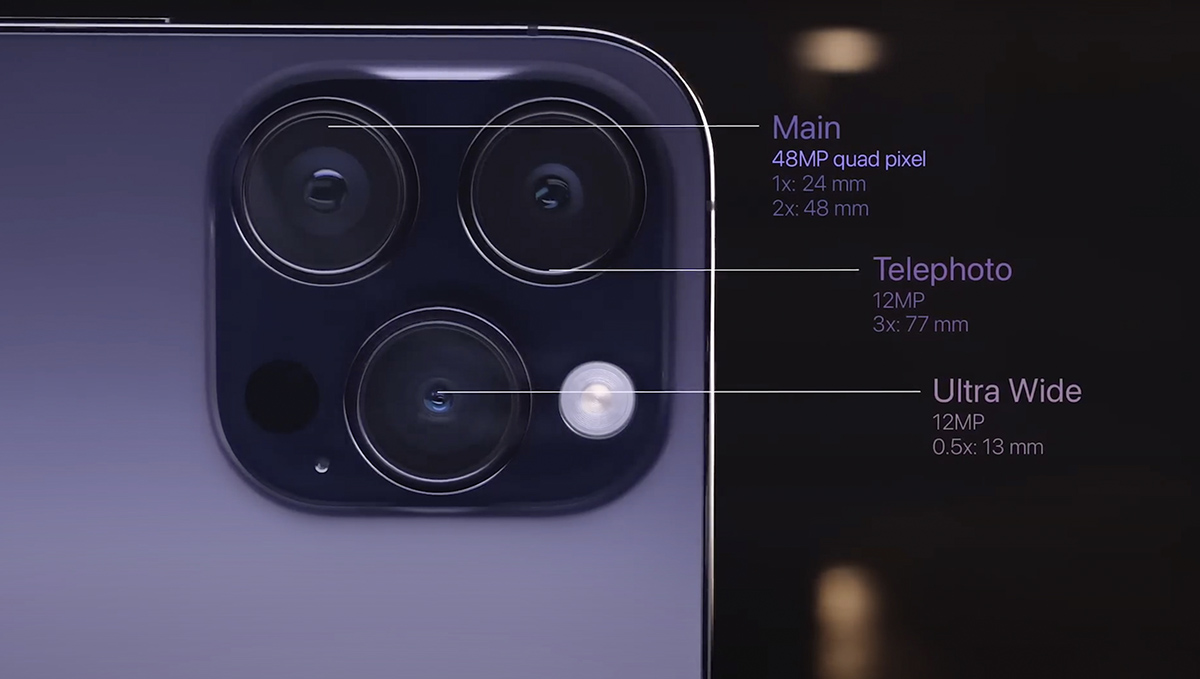

Se avete un iPhone e volete realizzare un bel ritratto con l’obiettivo tele, può accadere che lo smartphone della mela non lo utilizzi e scatti invece con l’ottica grandangolare salvo poi ritagliare l’immagine per fornirvi l’inquadratura che vedevate sul display. Sì, l’iPhone vi ha deliberatamente preso in giro. Ovviamente tutto questo è stato programmato per avere la maggior qualità possibile. Se siamo in situazioni di scarsa luminosità, è preferibile acquisire la foto con il sensore principale di dimensioni più grandi, ossia quello alle spalle dell’obiettivo grandangolare, e ritagliarla, anziché con il sensore più piccolo utilizzato nell’obiettivo tele, che è più soggetto a rumore ad alti ISO. Potete verificare questo fatto coprendo l’ottica tele: noterete che nelle condizioni ipotizzate lo scatto viene registrato ugualmente. Un algoritmo di fatto sta analizzando molte variabili e sta decidendo al posto nostro qual è la soluzione migliore.

Rapidità o controllo?

Questa invasione di campo viene percepita negativamente da chi ama controllare tutti i parametri della fotografia; al contrario, chi non ha queste priorità la vede come un fantastico aiuto, un’altra cosa di cui non preoccuparsi. Gli appassionati di fotografia ricercano la foto più neutra e dettagliata possibile per poi avere margine di sviluppo e postproduzione, cercano il controllo. Tutti gli altri invece cercano la foto pronta alla pubblicazione subito dopo lo scatto. Passare per qualsiasi fase di modifica è un peso e una perdita di tempo.

Sono entrambe visioni condivisibili, cambia l’approccio ovviamente. In tutto questo però dobbiamo essere consapevoli che se rinunciamo al controllo il pericolo è quello che le nostre foto diventino il risultato della visione di qualcun altro, ovvero del produttore del nostro smartphone (e domani della nostra fotocamera).

E questo è ancora niente. Andiamo avanti…

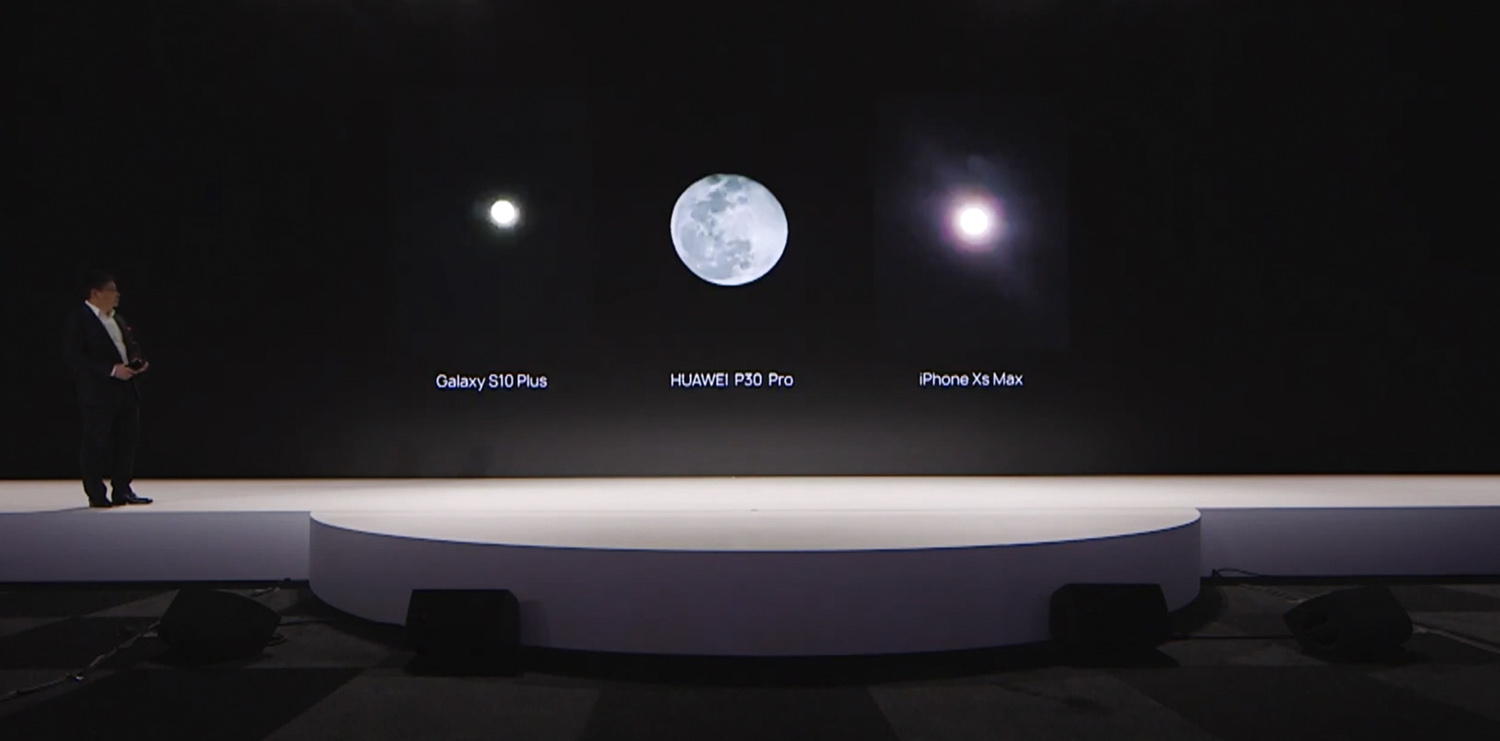

I primi sulla Luna? I cinesi di Huawei

Nel 2019 Huawei ha presentato il P30 Pro con la modalità “Luna” in grado di produrre scatti incredibilmente nitidi del nostro satellite naturale. Talmente sorprendenti da destare più di un sospetto: presto sono comparsi in rete test che dimostravano come Huawei non si limitava a migliorare e correggere le foto, ma utilizza immagini preesistenti della luna per comporre l’immagine finale. In pratica la foto scattata veniva “sostituita” con una migliore, presente in un database accessibile allo smartphone: una foto perfetta, ma non quella scattata dall’utente. Huawei ha sempre negato tutto, ma i test raccontano una storia diversa e il nuovo Huawei P30 Pro si è meritato la nomea di smartphone che “fa foto fake”.

Qui siamo davanti alla situazione in cui la foto è fantastica un istante dopo averla scattata senza fare nulla, “zero sbatti”. Quello che la maggior parte delle persone vuole. Lo scatto perfetto che di fatto nessun altro smartphone era in grado di fare. Ma ci stiamo spingendo in una nuova zona dove il dispositivo esegue interventi di editing decisamente invasivi, tenendo l’utente all’oscuro di tutto.

Xiaomi, il make up artist che ti vuole complice

Con lo Xiaomi Mi 11 Ultra invece, quando si entra nella modalità selfie c’è la possibilità di attivare la modalità beauty che permette all’utente di agire su svariati parametri in grado di migliorare la pelle, cambiare l’altezza dell’attaccatura dei capelli, la grandezza degli occhi, del naso, delle labbra, la forma del viso ecc. ancora prima di scattare. Xiaomi anticipa la fase di miglioramento rispetto al click, come a voler far credere che la foto che hai scattato è bellissima subito, senza bisogno di postproduzione.

In questo caso almeno è richiesta l’interazione con l’utente che diventa conscio delle modifiche in atto, sorvolando sugli aspetti socio-psicologici della necessità di alterare profondamente la propria immagine.

Google Pixel 6

Il Google Pixel 6, in alcune situazioni, quando si scatta una foto ad un soggetto in movimento e il viso risulta poco nitido, utilizza il supporto della fotocamera grandangolare, che per una serie di motivi può scattare con un tempo più rapido, per ricavare e sostituire il viso. Il tutto in modo istantaneo e impercettibile dall’utente. La foto, quindi, è l’unione di due scatti diversi.

Non ci metteremo molto ad arrivare a soluzioni più avanzate e complesse: ad esempio, una foto di gruppo in cui tutti i presenti hanno gli occhi aperti e stanno sorridendo, ottenuta dall’analisi e dall’unione selettiva di ogni soggetto presente in una serie di scatti realizzati in rapidissima sequenza. La foto sarà sicuramente perfetta e non richiederà alcuno sforzo aggiuntivo da parte dell’utente. Una foto di un momento che non è mai esistito.

Il principio che attribuisce alla fotografia il potere di rendere immortale un istante inizia a vacillare. E quindi, a cosa siamo disposti a rinunciare per avere la foto perfetta?

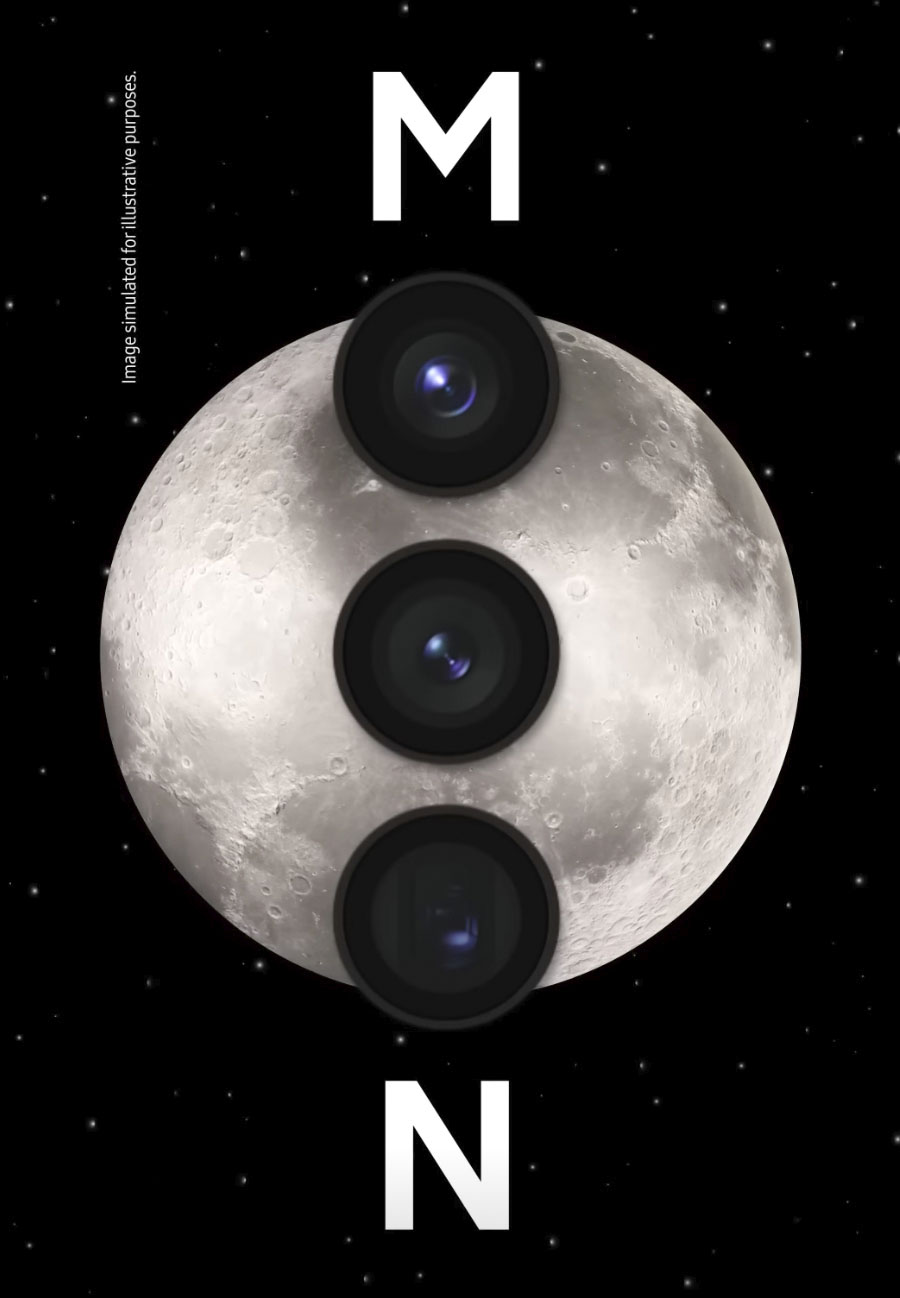

Samsung, sulla Luna c’è posto

Samsung ha presentato da poco il nuovo S23 Ultra animando il battage pubblicitario con questa immagine di lancio completamente incentrata sulla luna. Ancora una volta il fascino del nostro satellite viene utilizzato per presentare la nuova funzione “moon mode”. Ma al pari di Huawei è finita sul banco degli “imputati”: le foto della luna che si riescono ad ottenere sono pazzesche ma qualcuno ha voluto vederci meglio e si è accorto che scattando una foto di una luna sfuocata visualizzata su un monitor l’immagine che si ottiene ha decisamente più dettagli di quella inquadrata. Com’è possibile?

In poco tempo le notizie che Samsung sostituisse la luna nelle foto hanno cominciato a rimbalzare in rete, tanto che Samsung ha pubblicato un documento dove spiega come il software elabora l’immagine, in questo caso specifico. Quindi non c’è nessuna sostituzione con un’immagine preimpostata, ma un riconoscimento e un’analisi molto accurata della luna che viene in seguito migliorata tramite intelligenza artificiale. Un miglioramento in certi casi invasivo, che sicuramente porta ad un risultato molto preciso, ma che introduce comunque dettagli che nello scatto originale non c’erano.

Tornando sulla Terra

La luna è un caso limite e molto particolare, non è così semplice riprendere il nostro satellite, un corpo luminoso nel cielo buio, con uno zoom molto spinto che su uno smartphone tenuto in mano richiede una stabilizzazione estrema. Ma cosa succede in altre situazioni più comuni quando nella pipeline di ottimizzazione delle immagini rientra anche l’IA? Sempre il Samsung S23 Ultra ha fatto parlare di sé con questa foto pubblicata da un utente su reddit.

La corsa alla risoluzione, ben 200 MP sul sensore principale, obbliga a un utilizzo invasivo dell’intelligenza artificiale per ricostruire e aggiungere dettaglio dove non c’è, con risultati di questo tipo. Nello scatto notturno (a destra) qualcosa è andato storto, l’IA ha riconosciuto dei logogrammi cinesi nelle finestre del palazzo, un fenomeno che non si è verificato nello scatto diurno, dove la maggior quantità di luce ha permesso di generare un’immagine più nitida e quindi meno soggetta a errori interpretativi. Errori così grossolani sono rari, ma il problema è che ormai il dubbio si è insinuato nella nostra mente. Quello che sto registrando è la realtà?

Una questione etica, più che tecnologica

Più ci avviciniamo al concetto di “foto migliore pronta per la condivisione” più ci allontaniamo dalla realtà, viaggiando in direzione di un futuro distopico.

Quante e quali delle nostre facoltà possiamo delegare alla macchina prima di dover considerare non nostra, non autentica una fotografia? Siamo disposti ad accettare il riconoscimento del cibo per rendere i colori più saturi, o di un paesaggio per rendere il cielo più azzurro e l’erba più verde lo accettiamo? E l’uso dell’IA per tracciare il soggetto e mantenerlo a fuoco? Oppure l’unione di più scatti per aumentare la gamma dinamica va bene? Mentre il recupero del soggetto da fotogrammi diversi per evitare il mosso? E l’introduzione di dettagli da parte dell’IA?

Ed eccoci al momento in cui diviene fondamentale rivalutare il concetto di fotografia. La ricerca della perfezione ci sta portando in un futuro di cui non intuiamo che i contorni, perché queste elaborazioni, specialmente se legate all’IA, si stanno evolvendo a ritmi troppo elevati. Inoltre l’industria introduce queste funzioni tenendone l’utente all’oscuro, e forse questo è il punto con le implicazioni più negative e pericolose. Perché non adottare principi di trasparenza?

Fujifilm X-Half scende ancora di prezzo, ma c’è anche un’imperdibile offerta GoPro

Amazon inizia la settimana con una serie di sconti davvero interessanti: Fujifilm X-Half scende sotto i 600 euro e il ...

Fotolibri: la risposta all’archivio digitale per non “perdere la memoria”

Perchè il fotolibro resta la soluzione più concreta e modulare per dare corpo alle immagini. Abbiamo scelto ilfotoalbum.com per capire ...

Camp Snap 2: come cambia la miglior fotocamera digitale per bambini

Se avete letto il nostro articolo sulla Camp Snap sapete già di cosa si tratta: una compatta digitale senza display, ...

Canon annuncia l’Authenticity Imaging System: nell’era dell’IA generativa la provenienza delle immagini diventa certificabile

Authenticity Imaging System: Canon porta lo standard C2PA sulla Eos R1 e la Eos R5 Mark II per combattere l'IA ...

I microfoni DJI Mic 2 a un prezzo mai visto: poca spesa, massima resa per migliorare l’audio dei vostri video

Il kit con due microfoni, ricevitore e custodia per trasporto e ricarica dei DJI Mic 2 non è mai stato ...